3-工厂模式 - 创建型模式

本文共 2101 字,大约阅读时间需要 7 分钟。

文章目录

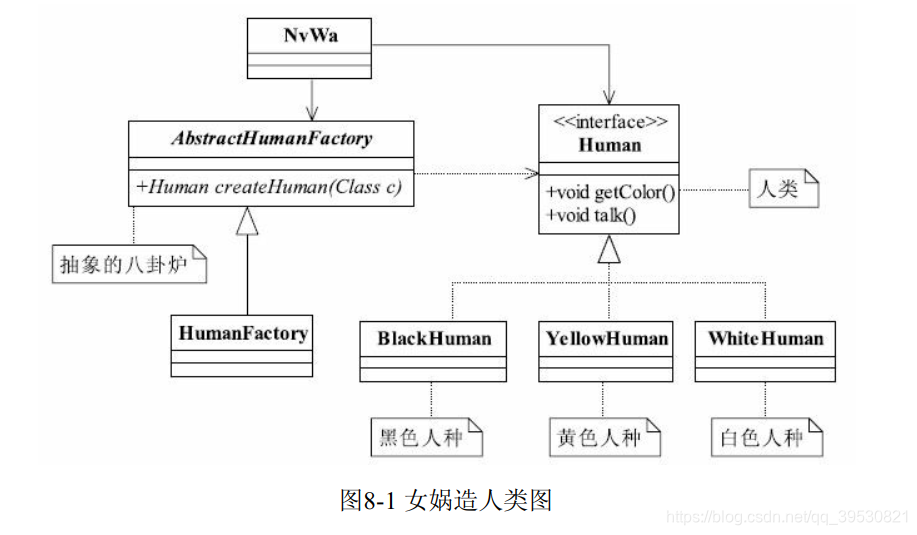

1. 例子

public interface Human { void getColor(); void talk();} 各个人种:

public class YellowHuman implements Human { @Override public void getColor() { System.out.println("YellowHuman is yellow"); } @Override public void talk() { System.out.println("YellowHuman talk"); }}public class WhiteHuman implements Human { @Override public void getColor() { System.out.println("WhiteHuman is white"); } @Override public void talk() { System.out.println("WhiteHuman talk"); }}public class BlackHuman implements Human { @Override public void getColor() { System.out.println("BlackHuman is black"); } @Override public void talk() { System.out.println("BlackHuman talk"); }} 工厂:

public abstract class AbstractHumanFactory { public abstract T createHuman(Class c);}public class HumanFactory extends AbstractHumanFactory { @Override public T createHuman(Class c) { T instance = null; try { instance = (T) Class.forName(c.getName()).newInstance(); } catch (Exception e) { System.out.println("创建人类失败"); } return instance; }} 女娲造人:

public class NvWa { public static void main(String[] args) { HumanFactory humanFactory = new HumanFactory(); YellowHuman yellowHuman = humanFactory.createHuman(YellowHuman.class); WhiteHuman whiteHuman = humanFactory.createHuman(WhiteHuman.class); BlackHuman blackHuman = humanFactory.createHuman(BlackHuman.class); yellowHuman.getColor(); yellowHuman.talk(); whiteHuman.getColor(); whiteHuman.talk(); blackHuman.getColor(); blackHuman.talk(); }} 2. 定义和特点

定义一个创建对象的接口,让子类决定实例化哪个类。工厂方法使得类的实例化延迟到子类。

有以下特点:

- 良好的封装性,代码结构清晰,调用者只需知道产品的类名或其他字符串就可以创建产品对象,不需要了解产品的创建过程;

- 扩展性优秀,可以扩展产品,像上面就可以增加棕色人种;

符合以下三个原则;

- 迪米特原则,工厂模式不需要对产品了解;

- 依赖倒置原则,只依赖产品的接口或者抽象类;

- 里氏替换原则,创建产品的方法参数是接口或抽象类。

3. 工厂模式的扩展

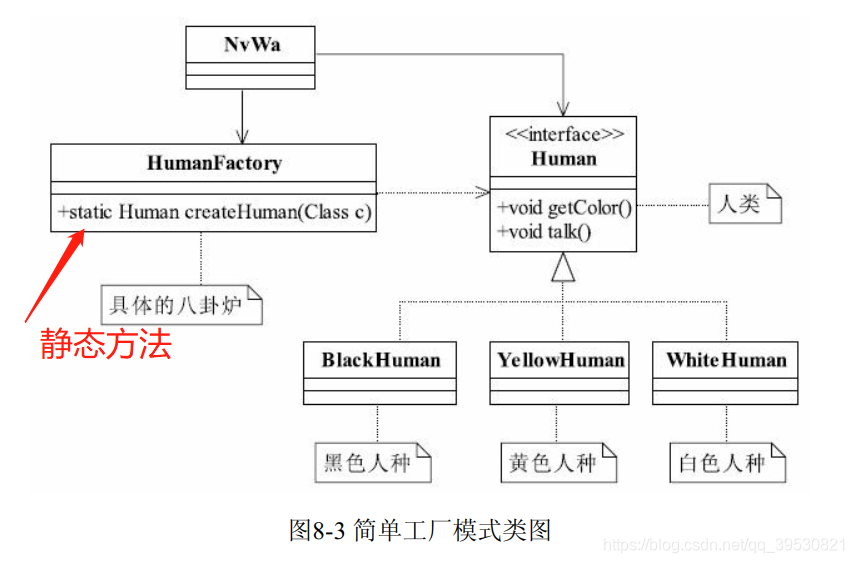

3.1 简单工厂模式

也叫静态工厂模式。

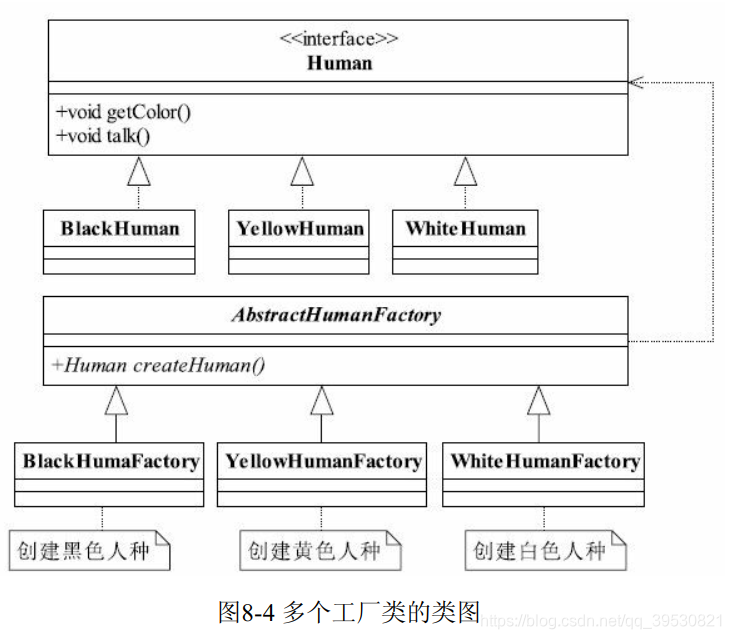

3.2 升级为多个工厂模式

转载地址:http://xphwz.baihongyu.com/

你可能感兴趣的文章

mysql8 配置文件配置group 问题 sql语句group不能使用报错解决 mysql8.X版本的my.cnf配置文件 my.cnf文件 能够使用的my.cnf配置文件

查看>>

MySQL8.0.29启动报错Different lower_case_table_names settings for server (‘0‘) and data dictionary (‘1‘)

查看>>

MYSQL8.0以上忘记root密码

查看>>

Mysql8.0以上重置初始密码的方法

查看>>

mysql8.0新特性-自增变量的持久化

查看>>

Mysql8.0注意url变更写法

查看>>

Mysql8.0的特性

查看>>

MySQL8修改密码报错ERROR 1819 (HY000): Your password does not satisfy the current policy requirements

查看>>

MySQL8修改密码的方法

查看>>

Mysql8在Centos上安装后忘记root密码如何重新设置

查看>>

Mysql8在Windows上离线安装时忘记root密码

查看>>

MySQL8找不到my.ini配置文件以及报sql_mode=only_full_group_by解决方案

查看>>

mysql8的安装与卸载

查看>>

MySQL8,体验不一样的安装方式!

查看>>

MySQL: Host '127.0.0.1' is not allowed to connect to this MySQL server

查看>>

Mysql: 对换(替换)两条记录的同一个字段值

查看>>

mysql:Can‘t connect to local MySQL server through socket ‘/var/run/mysqld/mysqld.sock‘解决方法

查看>>

MYSQL:基础——3N范式的表结构设计

查看>>

MYSQL:基础——触发器

查看>>

Mysql:连接报错“closing inbound before receiving peer‘s close_notify”

查看>>